1. Gouvernance de l’IA : Alignement Stratégique et Conformité

Avec l’essor de l’IA générative, les entreprises doivent revoir leur gouvernance afin d’aligner les initiatives IA avec leurs objectifs stratégiques. L’intégration de l’IA ne concerne plus uniquement les départements techniques, mais doit inclure des fonctions clés telles que la cybersécurité, les ressources humaines et le juridique. La conformité devient un enjeu central, notamment avec l’application du règlement AI Act de l’Union Européenne, qui impose des exigences strictes sur la transparence et la gestion des risques liés à l’IA. Pour répondre à ces impératifs, certaines entreprises créent des centres d’excellence IA, destinés à encadrer et accélérer l’adoption de ces technologies. Toutefois, la gouvernance de l’IA ne doit pas être uniquement un enjeu réglementaire ; elle doit également s’intégrer dans une logique de performance et d’innovation.

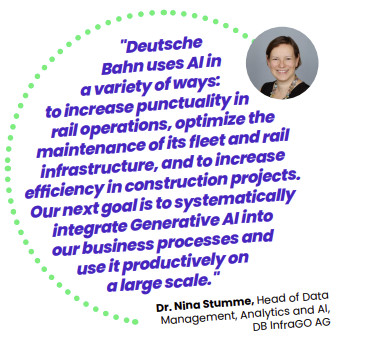

2. L’IA en action : Cas d’usage et adoption

Les grandes entreprises exploitent l’IA depuis plusieurs années à travers des technologies comme le machine learning et la vision par ordinateur. Aujourd’hui, l’IA générative ouvre la voie à des usages plus avancés, notamment dans la personnalisation des services, l’optimisation des processus métier et l’automatisation des tâches répétitives. Toutefois, le passage des preuves de concept (PoC) à une adoption à grande échelle reste un défi. De nombreuses entreprises ont du mal à démontrer le retour sur investissement (ROI) des projets IA, car les gains de productivité sont souvent diffus et difficiles à quantifier. Une approche pragmatique consiste à identifier des cas d’usage stratégiques et à s’assurer d’une adoption progressive en impliquant les utilisateurs finaux dès la phase de conception.

3. Enjeux techniques de l’IA traditionnelle et générative

Le choix entre IA traditionnelle et IA générative est un dilemme pour de nombreuses entreprises. Si l’IA générative permet d’exploiter de nouveaux types de données et de créer du contenu de manière autonome, elle est également plus coûteuse en ressources et peut produire des erreurs (« hallucinations »). À l’inverse, l’IA traditionnelle est plus robuste et plus efficace pour des cas d’usage spécifiques. Une question clé pour les entreprises est le modèle économique : faut-il développer ses propres modèles ("Make") ou s’appuyer sur des solutions externes ("Buy") ? De plus, la montée en puissance des architectures multi-modales et des agents IA autonomes annonce une nouvelle ère où l’IA combinera plusieurs types de données et interagira de manière plus fluide avec les systèmes existants.

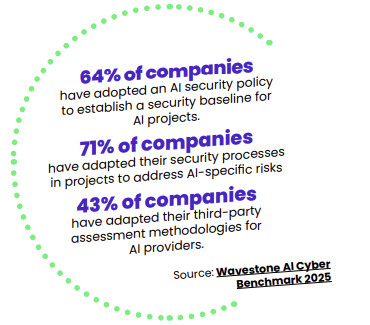

4. Sécurité et cybersécurité : faire face aux nouvelles menaces

L’IA représente un double défi en cybersécurité : elle peut être utilisée pour renforcer les systèmes de défense, mais elle expose également les entreprises à de nouveaux types de cyberattaques. Les risques incluent les deepfakes, le phishing avancé et les attaques adversariales visant à manipuler les modèles IA. Face à ces menaces, 71 % des entreprises ont déjà adapté leurs processus de sécurité pour inclure des contrôles spécifiques aux projets IA. De plus, la dépendance aux fournisseurs externes pose un problème de souveraineté et de contrôle des données. Pour gérer ces défis, les entreprises adoptent une approche basée sur le risque, combinant audits de sécurité, tests d’attaque IA ("red teaming") et cadres de gouvernance comme l’AI Act et le NIST AI RMF.

5. Éthique et impact environnemental de l’IA

L’essor de l’IA soulève des questions éthiques majeures, notamment en matière de biais algorithmiques, d’inclusion et de protection de la vie privée. L’IA générative, en particulier, pose des défis sur la traçabilité des contenus, la propriété intellectuelle et l’explicabilité des décisions algorithmiques. Par ailleurs, son empreinte écologique est préoccupante : l’entraînement et l’inférence des modèles d’IA consomment énormément d’énergie et d’eau. Certaines entreprises commencent à adopter des pratiques d’ingénierie verte, comme les Small Language Models (SLM), qui sont plus économes en ressources. Toutefois, l’absence de transparence des fournisseurs IA et le manque de standards de mesure d’impact limitent les efforts en faveur d’une IA plus durable.

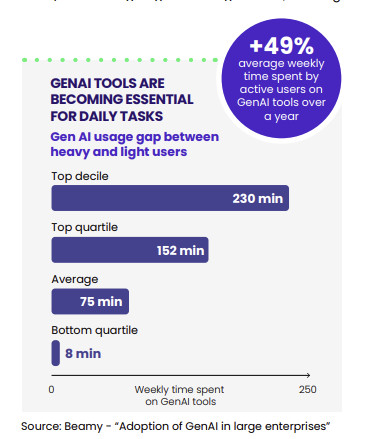

6. Transformation du travail et impact sur les compétences

L’IA transforme en profondeur les modes de travail et les compétences requises dans les entreprises. Alors que les outils d’IA générative deviennent de plus en plus accessibles, le défi principal est d’assurer une montée en compétences des employés. Aujourd’hui, si la majorité des travailleurs sont familiers avec l’IA via leur usage personnel, les compétences avancées comme le "prompt engineering" restent rares. Pour éviter une adoption anarchique (phénomène du "Shadow AI"), certaines entreprises déploient des outils IA sécurisés internes, comme Microsoft Copilot ou Google Gemini. Les départements RH doivent anticiper ces évolutions et adapter leurs modèles d’évaluation des performances pour prendre en compte l’impact de l’IA sur la productivité et les responsabilités.

7. Course aux talents et autonomie stratégique en IA

La guerre des talents en IA s’intensifie, avec une pénurie mondiale de spécialistes en intelligence artificielle. Les entreprises traditionnelles doivent rivaliser avec les grands acteurs technologiques qui offrent des salaires et des opportunités attractifs. Pour répondre à ce défi, plusieurs stratégies émergent : formation continue, partenariats avec les universités, et diversification des profils recrutés (ingénieurs, statisticiens, mais aussi spécialistes de l’éthique et du droit). Par ailleurs, l’Europe accuse un retard significatif en matière d’investissements en IA par rapport aux États-Unis et à la Chine, ce qui pose un problème de souveraineté technologique. Le développement d’IA open-source et la mise en place de Data Spaces sectoriels sont des solutions envisagées pour réduire cette dépendance.

Conclusion : une IA stratégique et responsable

L’intelligence artificielle est désormais au cœur des stratégies d’entreprise, mais son adoption implique de concilier innovation, gouvernance, sécurité et responsabilité sociétale. Les défis liés à la conformité, à la cybersécurité et à l’éthique nécessitent une approche collaborative entre les acteurs privés et publics. L’IA doit être pensée comme un levier de performance durable, capable d’améliorer la productivité sans compromettre les valeurs fondamentales des organisations. Seules les entreprises qui sauront intégrer ces nouvelles technologies de manière éthique, sécurisée et stratégique tireront pleinement parti de l’ère de l’IA.

Sources : Telecharger le livre blanc

-thumb.webp)